开篇引入:如果问你“AI助手App软件是如何听懂人话、还能帮你办事的”,你能说清背后的技术逻辑吗?市面上每天都有大量AI助手上线,从ChatGPT、Gemini到豆包、千问,用户动动嘴就能完成订外卖、查天气、写周报——但大多数人只会用,不懂原理,面试时被问到“RAG和Agent有什么区别”“MCP和Function Calling谁更底层”就卡壳。实际上,AI助手App软件的技术体系正从单点智能向多智能体协同快速演进,理解其背后的架构脉络,已成为技术学习者绕不开的核心知识。本文将围绕“大模型→AI助手→智能体”这条主线,层层拆解核心概念、运行机制与底层原理,配合简洁代码示例和高频面试考点,帮你建立完整的技术认知链路。

一、痛点切入:为什么需要搞懂AI助手App软件的技术本质

先看一个典型的开发场景。假设你要写一个AI聊天应用,用户问“今天北京天气怎么样”。传统思路是这样的:

传统实现:硬编码if-else规则def chatbot_response(user_input): if "天气" in user_input and "北京" in user_input: return "今天北京晴,气温25°C" elif "股票" in user_input: return fetch_stock_price() else: return "我不太明白你的意思"

这种方式的弊端非常明显:每条规则都要人工硬编码,新加一个意图就得改代码;规则交叉时会互相冲突;用户换个问法“北京今天热不热”就会答不出来。

为了解决这类问题,行业引入了大模型+Function Calling的方案,但这只是第一步。真正让开发者困惑的是:RAG、Agent、MCP、Function Calling这些概念之间到底是什么关系?百度集团副总裁王颖在MEET2026大会上曾直言,当前AI产品存在认知偏差、落地断层、体验割裂三大痛点——用户与AI之间存在大量“理解盲区”,而技术工作者同样面临概念术语的“迷雾”-27。本文将聚焦AI助手App软件的技术架构,从“能说会道”到“能想会做”的全链条进行讲解。

二、核心概念讲解:大模型——AI助手的“大脑”

大语言模型(Large Language Model, LLM) 是基于Transformer架构、通过海量文本预训练获得的通用语言理解和生成模型-11。GPT、DeepSeek、通义千问都属于这一层级。

用生活化类比理解:大模型就像给AI装了一个“超强语言中枢”——你输入任何问题,它能输出看起来有逻辑的答案。但它有个致命短板:没有记忆、不会主动行动,就像一个沉睡的“超级大脑”,必须等人拍醒它才能回答一句。

Transformer架构的核心是自注意力机制:模型在处理每个词时,会动态计算与上下文中所有词的相关性权重,从而“看清”整个句子的全局关系。以下为注意力计算的简化实现:

import torch def scaled_dot_product_attention(Q, K, V): Q(查询), K(键), V(值) 是输入矩阵 scores = torch.matmul(Q, K.transpose(-2, -1)) / (K.shape[-1] 0.5) weights = torch.softmax(scores, dim=-1) return torch.matmul(weights, V)

Transformer通过这种注意力机制并行处理整个序列,而非逐词递归,这正是大模型能够高效处理长上下文的原因。

三、关联概念讲解:AI助手——大模型的“交互外衣”

AI助手(AI Assistant) 是在大模型外围包裹了一层交互界面与记忆管理的应用形态,能进行多轮对话,但本质上仍是“人问、AI答”的被动交互模式-11。

用对比来理解:大模型是“会说话的大脑”,而AI助手是“长出了嘴巴和耳朵的大脑”。AI助手增加了三项关键能力:

对话管理:记住最近几轮对话的内容(短期记忆);

上下文理解:根据当前会话场景调整回答风格;

提示词工程:将用户输入包装成模型更容易理解的结构。

比如你问豆包“帮我订明天下午3点的闹钟”,豆包需要先理解“明天”是哪个日期、“下午3点”是15:00,然后调用系统API去执行。这个过程涉及到“理解→规划→调用→反馈”的链条,而这个链条的自动化和深度,正是从AI助手走向智能体(Agent) 的关键一跃。

四、概念关系与区别总结:大模型、AI助手、智能体——一张图看清

| 层级 | 核心角色 | 主动/被动 | 典型例子 |

|---|---|---|---|

| 大模型 | 能力底座 | 被动响应 | GPT-4o、DeepSeek-V3 |

| AI助手 | 交互入口 | 用户驱动,被动执行 | ChatGPT、豆包 |

| 智能体 | 任务执行体 | 自主规划与行动 | AutoGPT、千问Agent |

一句话概括:大模型是“大脑”,AI助手是“会说话的大脑”,智能体是“会行动、会协作、会学习的数字员工”-11。

从技术演进来看,AI应用正从“单模型智能”向“多智能体协同”演化-10。RAG让模型“知道”更多实时知识,Agent让模型“能做”更多事情,而MCP让不同AI之间可以“协同工作”-10。三者构成了一套分层架构:

┌────────────────────────┐ │ Agent 层(智能行动) │ ← 执行任务、决策与协作 ├────────────────────────┤ │ RAG 层(知识增强) │ ← 提供实时知识支撑 ├────────────────────────┤ │ MCP 层(协议标准) │ ← 统一上下文与资源接入 └────────────────────────┘

这一分层架构正是2026年AI助手App软件开发的核心范式。

五、代码流程示例:用Vercel AI SDK搭建一个AI助手

以开源方案@openassistant/core为例(基于Vercel AI SDK),展示如何用不到20行代码构建一个可运行AI助手-30:

import { createAssistant } from '@openassistant/core'; // 创建助手实例 const assistant = await createAssistant({ name: 'my-assistant', modelProvider: 'openai', // 可换为deepseek、google等 model: 'gpt-4o', apiKey: 'your-api-key', instructions: '你是一个专业的技术助手,擅长回答编程问题' }); // 发送消息并处理流式响应 await assistant.processTextMessage({ textMessage: '解释一下什么是RAG', streamMessageCallback: ({ isCompleted, message }) => { console.log(isCompleted ? '完成' : '接收中:', message); } });

这段代码在做什么?

createAssistant初始化一个助手实例,绑定模型提供商、模型版本和角色指令;processTextMessage将用户消息发送给大模型;streamMessageCallback以流式方式逐步接收模型的返回内容,提升用户体验。

如果需要添加工具调用能力(比如查询天气、数据库),可以像这样定义工具:

const weather = tool({ parameters: z.object({ city: z.string().describe('城市名称'), date: z.string().describe('日期') }), execute: async ({ city, date }) => { // 调用真实天气API return await fetchWeather(city, date); } });

六、底层原理技术支撑:从Function Calling到MCP

AI助手之所以能“做事”,底层依赖两大核心技术:

1. Function Calling(函数调用) :大模型在理解用户意图后,不直接输出自然语言,而是输出一个结构化的JSON对象,指明要调用哪个函数、参数是什么。应用层收到这个JSON后执行对应的API,再将结果返回给模型生成最终回答-。这解决了大模型无法获取实时数据(天气、股价)的困境。

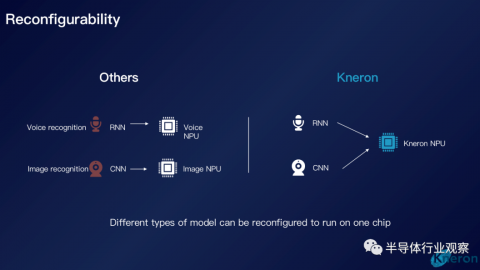

2. MCP(模型上下文协议,Model Context Protocol) :由Anthropic于2024年末推出,旨在统一AI模型与外部系统的交互方式-。截至2026年初,全球已有超过1万个活跃MCP服务器,月均SDK下载量达到9700万次-。MCP的核心价值可类比USB接口之于外设——统一了AI“插拔”各种工具的规范,使开发者无需为每个工具编写定制集成。

两者的关系是:Function Calling是“单次调用”的手段,MCP是“全局集成”的标准。

七、高频面试题与参考答案

Q1:大语言模型(LLM)的核心原理是什么?

A:LLM基于Transformer架构的自注意力机制,通过海量文本预训练学习语言的统计规律和语义表征。核心流程:输入文本分词→位置编码→多层Transformer堆叠(自注意力+前馈网络)→输出概率分布,逐词生成回应。关键技术包括注意力机制、残差连接、层归一化。

Q2:RAG和Agent有什么区别?

A:RAG(检索增强生成,Retrieval-Augmented Generation)专注于“让模型知道更多”——在生成回答前先从知识库检索相关信息,解决知识时效性问题。Agent(智能体)则专注于“让模型能做更多”——具备自主规划、工具调用、记忆管理和反馈修正能力,可独立完成多步骤任务。一句话:RAG让模型博闻,Agent让模型多能。

Q3:Function Calling是如何工作的?

A:开发者在请求中声明可用工具列表(名称、参数JSON Schema);模型理解用户意图后决定是否调用工具,若需要则返回包含工具名称和参数的JSON对象;应用层执行该工具并将结果返回给模型;模型整合结果生成最终自然语言回复。

Q4:MCP协议解决什么问题?

A:在无MCP时,每个AI系统需为每个工具编写定制集成(N×M复杂度)。MCP统一了AI与外部系统交互的标准——工具发现、参数传递、权限管理、上下文传递均有统一规范,使AI系统之间及AI与系统之间可互操作。

Q5:如何优化AI助手的响应延迟?

A:①模型推理(占60%):采用模型量化、蒸馏或异步推理(TensorRT加速);②工具调用(占30%):实施并行化调用(concurrent.futures)、使用缓存(Redis);③网络开销:就近部署、请求合并批处理。

八、结尾总结

回顾全文核心知识点:

大模型是AI的能力底座,Transformer架构的自注意力机制是其核心;

AI助手是在大模型外围封装了交互界面与对话管理的应用形态;

智能体(Agent) 进一步赋予AI自主规划、工具调用和任务执行能力;

RAG、Agent、MCP构成新一代AI应用的三层架构,分别解决“知道”“能做”“协同”三个维度的问题;

Function Calling是实现工具调用的底层手段,MCP是统一集成的行业标准。

2026年,AI正从“对话式交互”迈向“任务式执行”。理解大模型→AI助手→智能体这条演进脉络,不仅有助于应对面试,更是参与下一代AI应用开发的必修课。后续文章将深入讲解RAG的向量检索原理、Agent的多步推理机制,以及MCP的生产级部署方案,欢迎持续关注。