在数字化转型进入深水区的今天,

一、痛点切入:为什么传统实现方式行不通?

先来看一个典型场景:假设你需要在企业内部系统中集成一个智能助手,让员工可以通过自然语言查询公司规章制度、审批流程和业务数据。

传统实现方式(伪代码示例):

传统做法:硬编码规则 + 关键词匹配 def handle_query(query): if "请假" in query: return "请填写请假申请表并提交直属领导审批" elif "报销" in query: return "请上传发票并填写报销单" elif "加班" in query: return "加班需提前申请,经项目经理确认" else: return "抱歉,我没有理解您的问题,请咨询HR部门"

传统做法的致命缺陷:

耦合度高:每新增一个业务场景,就需要修改代码、重新部署,维护成本呈线性增长

扩展性差:无法处理多轮对话,也无法跨上下文关联信息

覆盖不全:企业规章制度动辄上千页,关键词匹配的召回率极低

无推理能力:无法理解“如果下周三请病假,需要提前多久提交申请”这类复合逻辑问题

正是这些痛点,催生了内嵌AI助手的核心设计理念:不再依赖开发者预先编写所有规则,而是让大语言模型(Large Language Model,LLM)动态理解用户意图,结合企业内部知识库做出推理和响应。

二、核心概念讲解:LLM(大语言模型)

标准定义

大语言模型(Large Language Model,LLM) 是基于Transformer架构,通过海量文本数据进行预训练,拥有数十亿乃至万亿参数的深度学习模型-。其核心能力在于理解和生成自然语言。

关键词拆解

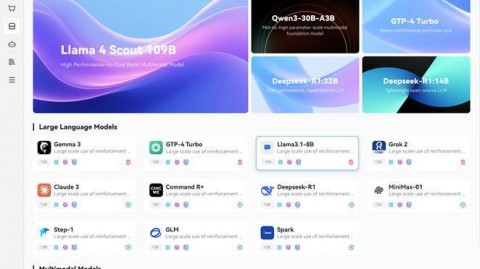

“大”:指参数量巨大。2026年的主流模型参数量从几亿到数千亿不等。Google开源的Gemma 4系列中,31B模型凭借仅310亿的参数即可达到开放模型排行榜第3名的水平-22。

“语言模型”:本质是“下一个token预测器”——给定前文,预测最可能出现的下一个词或子词单元(token)。

生活化类比

把LLM想象成一个“见过全世界书籍的图书馆管理员”。你给他一个问题,他不会翻遍每一本书,而是基于他“读过的所有书”形成的知识网络,直接给出最可能的答案。他的优点是知识广博、反应迅速;缺点是——他记得“常识”,但不知道你们公司的内部规定。

作用与解决的问题

LLM解决了传统系统“无法理解自然语言”的根本问题。当员工问“我下周三身体不舒服该怎么办”,LLM能准确识别意图——这不再是简单的关键词匹配,而是语义层面的理解。

三、关联概念讲解:RAG(检索增强生成)

标准定义

检索增强生成(Retrieval-Augmented Generation,RAG) 是一种让LLM在回答问题时,先从外部知识库中检索相关信息,再将检索结果作为“参考资料”连同用户问题一起交给LLM生成答案的技术框架。

RAG与LLM的关系

如果说LLM是“有常识但没有私域知识的博学者”,那么RAG就是为这位博学者配备的一个“实时资料检索员”。RAG不是取代LLM,而是增强LLM——让LLM能够获取其训练数据之外的最新信息和企业内部知识。

运行机制示例

RAG简化流程伪代码 def rag_answer(user_question): 步骤1:将用户问题向量化 question_vector = embedding_model.encode(user_question) 步骤2:在向量数据库中检索相关文档 relevant_docs = vector_db.similarity_search(question_vector, top_k=5) 步骤3:构建增强提示词 enhanced_prompt = f""" 参考以下内部资料: {relevant_docs} 请基于以上资料回答:{user_question} """ 步骤4:LLM生成最终答案 return llm.generate(enhanced_prompt)

2026年,RAG已成为企业级AI助手的主流技术范式。支撑百万级甚至千万级Token的长文本处理已成为标配,使得AI能够通过RAG实时检索并理解海量企业私域文档-54。

四、核心概念讲解:Agent(智能体)

标准定义

AI智能体(AI Agent) 是一个能够感知环境、自主规划、调用外部工具并执行任务以达成目标的自主系统。它不再仅仅是“回答问题”,而是能够“完成任务”。

Agent与RAG的关系

RAG:解决“LLM不知道怎么办”——提供参考信息

Agent:解决“LLM只能动口不能动手”——提供行动能力

二者的关系可以类比:RAG让LLM“知道更多”,Agent让LLM“做到更多”。一个完整的Agent架构通常包含三层-1:

| 层级 | 功能 | 2026年技术实现 |

|---|---|---|

| 交互层 | 人与AI的对话界面 | AI对话组件、语音识别插件 |

| 智能决策层 | 任务规划、工具调用、状态管理 | RAG引擎、函数调用、MCP协议 |

| 系统连接层 | 调用企业系统(ERP/数据库/API) | Web API、MCP服务端 |

一句话总结三者关系

LLM是“大脑”,RAG是“图书馆”,Agent是“双手”。

LLM负责理解和生成

RAG负责从知识库中查找信息

Agent负责规划任务并调用外部工具执行

五、代码示例:如何将AI助手嵌入Web应用

下面展示一个极简但完整的示例:使用Vercel AI SDK将大模型能力嵌入Next.js应用,构建一个具有工具调用能力的智能助手。

步骤1:创建API路由(app/api/chat/route.ts)

import { openai } from '@ai-sdk/openai'; import { streamText, tool } from 'ai'; import { z } from 'zod'; export async function POST(req: Request) { const { messages } = await req.json(); const result = streamText({ model: openai('gpt-4o'), messages, tools: { // 定义一个查询天气的工具 getWeather: tool({ description: '获取指定城市的当前天气', parameters: z.object({ city: z.string().describe('城市名称'), }), execute: async ({ city }) => { // 实际项目中调用真实天气API return { city, temperature: 22, condition: '晴天' }; }, }), // 定义一个查询内部知识库的工具(RAG核心) searchKnowledgeBase: tool({ description: '查询企业内部知识库', parameters: z.object({ query: z.string().describe('关键词'), }), execute: async ({ query }) => { // 调用向量数据库进行语义检索 const results = await vectorDB.similaritySearch(query); return { documents: results }; }, }), }, }); return result.toDataStreamResponse(); }

步骤2:前端集成(app/page.tsx)

'use client'; import { useChat } from 'ai/react'; export default function Chat() { const { messages, input, handleInputChange, handleSubmit } = useChat({ api: '/api/chat', }); return ( <div className="flex flex-col h-screen"> <div className="flex-1 overflow-y-auto p-4"> {messages.map(m => ( <div key={m.id} className="mb-4"> <strong>{m.role === 'user' ? '用户' : 'AI助手'}:</strong> <div>{m.content}</div> </div> ))} </div> <form onSubmit={handleSubmit} className="p-4 border-t"> <input value={input} onChange={handleInputChange} placeholder="问点什么吧..." className="w-full p-2 border rounded" /> </form> </div> ); }

关键代码解读:

streamText:实现流式输出,避免用户长时间等待tools参数:定义AI助手可以调用的“工具”,这是Agent能力的核心execute函数:当AI判断需要调用该工具时自动执行,并将结果返回给LLM继续推理

上述代码展示了一个完整的AI智能体交互流程:用户提问 → LLM判断是否需要调用工具 → 执行工具(RAG检索/API调用)→ 整合结果 → 流式返回答案。

六、底层原理支撑

内嵌AI助手的高效运作,依赖于以下几项底层技术:

1. Transformer与自注意力机制

LLM的核心架构Transformer通过自注意力机制(Self-Attention) 计算序列中每个token与其他token的相关权重,从而实现上下文感知-59。简化的注意力计算逻辑如下:

def scaled_dot_product_attention(Q, K, V): scores = torch.matmul(Q, K.transpose(-2, -1)) / (K.shape[-1] 0.5) weights = torch.softmax(scores, dim=-1) return torch.matmul(weights, V)

2. 上下文窗口的突破

2026年的标志性进展是百万级Token上下文窗口的普及。Anthropic的Claude Opus 4.6和Sonnet 4.6已全面上线100万Token上下文窗口,这意味着AI可以一次性理解整套代码库,且不再收取长文本溢价-49。Google的Gemma 4系列中,边缘模型支持128K上下文,更大参数模型则支持256K-22。

3. 混合专家模型(MoE)与端侧部署

MoE架构通过“只激活部分专家”来降低推理成本。例如Gemma 4的26B MoE模型推理时仅激活38亿参数,大幅提升了响应速度-22。与此同时,端侧部署成为2026年的核心趋势——3B到30B参数规模的模型已能在智能手机和边缘设备上运行,提供GPT-4级别的能力-。

七、高频面试题与参考答案

面试题1:请解释LLM、RAG和Agent三者的关系。

参考答案要点:

LLM是“大脑” ,负责语义理解与文本生成,是核心推理引擎

RAG是“图书馆” ,负责从外部知识库检索信息,弥补LLM知识时效性和私域覆盖的不足

Agent是“双手” ,负责任务规划与工具调用,赋予AI执行实际业务操作的能力

核心逻辑:LLM提供基础能力,RAG扩展知识边界,Agent实现闭环执行。三者叠加,才能构建完整的企业级AI助手

加分点:能结合业务场景举例,如“客服场景中RAG查询产品手册、Agent调用订单系统、LLM生成自然回复”

面试题2:什么是RAG?它和微调(Fine-tuning)的区别是什么?

参考答案要点:

RAG定义:检索增强生成,在推理时动态检索外部知识库,将检索结果作为上下文供LLM生成答案

核心区别:

RAG:无需训练,动态检索,适合知识频繁更新的场景(如企业内部文档)

微调:需要训练数据,知识固化到模型参数中,适合风格/格式/能力的定制化

选型建议:知识频繁更新 → RAG;风格/角色固定 → 微调;两者可结合使用

面试题3:Agent如何实现工具调用?请简述工作流程。

参考答案要点:

核心机制:通过函数调用(Function Calling)规范——LLM输出结构化的工具调用请求,而非直接回答

工作流程:用户输入 → LLM判断是否需要工具 → 输出调用请求 → 系统执行工具 → 结果返回LLM → LLM生成最终答案

技术保障:使用JSON Schema定义输入参数类型,提供示例输入/输出,提高调用准确率-59

MCP协议:2026年主流的标准化工具调用方式,让AI Agent能通过统一接口访问外部系统和数据库-1

面试题4:如何优化AI助手的响应延迟?

参考答案要点:

延迟来源分析:模型推理约占总延迟的60%,工具调用约占30%

模型层优化:采用异步推理(如TensorRT加速)、使用量化模型(4-bit替代16-bit)、选择MoE架构模型(仅激活部分参数)

工具层优化:并行化API调用、缓存重复查询结果(如Redis)、批处理合并请求-59

架构层优化:边缘侧部署优先处理高频任务,云端处理复杂推理

八、结尾总结

本文围绕内嵌AI助手的核心技术体系,从传统方案的痛点切入,系统梳理了LLM、RAG、Agent三大核心概念及其逻辑关系,并提供了完整的代码示例与面试要点。核心知识点回顾:

LLM:基于Transformer的自然语言理解和生成引擎,是所有AI助手的大脑

RAG:检索增强生成技术,让LLM能够获取企业私域知识,解决“知识盲区”问题

Agent:自主任务规划与工具调用的执行系统,让AI“不仅能说还能做”

易错点提醒:不要将RAG和Agent混为一谈——RAG解决“知道什么”,Agent解决“能做什么”。在实际面试和工程实践中,准确区分这两个概念是高频考点。

随着百万级上下文窗口的普及和端侧AI能力的跃升,2026年的内嵌AI助手正从“辅助工具”演变为“协作伙伴”。下一篇文章我们将深入探讨Agent的规划与执行机制,以及如何基于LangChain等框架构建生产级AI智能体。敬请期待!