发布时间:2026年4月10日

进入2026年,AI领域正经历一场从“对话框”到“行动力”的根本性范式转移,如何创建AI助手已从少数开发者的技术探索,演变为技术从业者必须掌握的技能标准。越来越多企业正在将AI智能体(AI Agent)纳入核心业务流程——数据显示,超过92%的企业决策者已在核心业务流程中部署AI Agent-55。许多人能熟练使用现成工具如豆包、ChatGPT,却在需要自主构建智能助手时手足无措:不清楚Agent和大模型究竟有何区别,不知道如何选择开发框架,更缺乏一套清晰的构建方法论。本文将从概念到实践,带你完整掌握如何创建AI助手的全部流程,配套可运行的代码示例和高频面试考点,助你从“使用者”进阶为“创造者”。

一、基础概念:AI助手和AI智能体到底有什么区别?

在讨论如何创建AI助手之前,必须先理清一个核心问题:我们常说的“AI助手”和“AI智能体”(AI Agent)是不是一回事?答案是否定的。

1.1 三个层级的概念辨析

要理解AI助手,需要先厘清三个基本概念:

大语言模型(Large Language Model, LLM) :本质上是一个“超级语言引擎”——给定输入、输出文本。它被动响应、没有记忆,也不会主动行动。GPT、DeepSeek、通义千问这些模型都属于这一层级-4。

AI助手(如ChatGPT、豆包) :在大模型外包裹了一层交互界面与记忆管理,能进行多轮对话,但本质依然是“人问、AI答”的被动交互模式,执行的边界止步于文字回应-4。

AI智能体(AI Agent) :能够自主感知环境、独立制订计划、调用工具、执行行动,并在结果反馈中动态调整策略的系统。它有四大核心特征:自主目标分解、工具调用能力、闭环行动能力、持久记忆与状态管理-4。

一个通俗的比喻是:大模型是“大脑”,AI助手是“会说话的大脑”,而智能体是一个“会行动、会协作、会学习的数字员工”-4。

1.2 AI助手的核心架构

一个成熟的AI助手通常由四大核心模块协同构成:

| 模块 | 功能 | 实现要点 |

|---|---|---|

| 感知模块 | 采集多源信息并结构化处理 | 理解用户意图,识别对话语境 |

| 大脑模块 | 以大语言模型为核心进行推理与规划 | 任务分解、决策判断 |

| 行动模块 | 调用外部工具执行操作 | API调用、代码执行、数据库查询 |

| 记忆模块 | 短期与长期记忆管理 | 上下文保持、知识库检索 |

这套架构支撑起“感知→规划→行动→记忆”的完整认知闭环,推动AI从被动响应迈向自主智能-1。

二、为什么要创建AI助手?——痛点驱动的技术演进

传统开发方式依赖硬编码的业务逻辑,每次新增功能都需要修改代码、重新发布。而基于AI助手的方案,让系统能够理解自然语言、自主决策调用哪些工具,极大地提升了灵活性和可扩展性。

2.1 传统实现方式的局限

以“智能问答客服”为例,传统实现方式通常依赖:

传统方式:基于关键词的if-else匹配 def traditional_chat(user_input): if "订单" in user_input and "查询" in user_input: return query_order(user_input) elif "退款" in user_input: return process_refund(user_input) elif "物流" in user_input: return query_logistics(user_input) else: return "抱歉,请转人工客服。"

这种方式存在明显缺陷:

耦合度高:每增加一个业务场景就要修改核心代码

扩展性差:无法处理未预先定义的场景

维护成本高:业务规则变更需要频繁发布版本

表达能力弱:无法理解复杂语义和多轮上下文

2.2 AI助手的解决方案

基于LLM的AI助手方案,让模型自主理解用户意图,动态决定调用哪些工具:

AI助手方式:Agent自主决策 from langchain.agents import create_agent 定义可用工具 tools = [query_order, process_refund, query_logistics] agent = create_agent(model="gpt-4o", tools=tools) Agent自动判断用户意图并调用相应工具 response = agent.invoke({"messages": [{"role": "user", "content": "我的订单什么时候到?"}]})

这种方式让系统从“被动响应指令”升级为“主动理解任务”,是智能体技术演进的核心方向-9。

三、核心技术框架:LangChain与Agent开发范式

LangChain是目前最主流的AI Agent开发框架。根据LangChain官方介绍,它提供了一个用于构建由大语言模型驱动的AI助手的标准化框架,是与OpenAI、Anthropic、Google等主流模型集成的核心工具,也因此成为入门AI Agent开发的最佳途径-19。

3.1 LangChain核心概念

LangChain v1通过一个统一的create_agent函数替代了多个不同类型的Agent,极大简化了开发流程-18。Agent遵循ReAct(Reasoning + Acting)模式运行:模型进行推理,在需要时调用工具,如此循环直到完成任务-18。

一个AI助手的核心构成公式可以表达为:

Agent = LLM + Planning + Memory + Tool Use-11

规划(Planning) :将模糊目标拆解为可执行的子任务

记忆(Memory) :结合RAG与长短期记忆,记住用户偏好与历史

工具使用(Tool Use) :自主调用外部API,从“说客”变成“创作者”

3.2 快速上手:5分钟搭建第一个AI助手

下面以天气查询助手为例,演示完整的创建流程:

第一步:安装依赖

pip install langchain langchain-openai python-dotenv第二步:配置环境变量

在项目根目录创建.env文件:

OPENAI_API_KEY=your_api_key_here第三步:编写Agent代码

from langchain.agents import create_agent from dotenv import load_dotenv load_dotenv() 定义工具函数(模拟天气查询) def get_weather(city: str) -> str: """根据城市名称获取天气信息""" 实际项目中可替换为真实API调用 return f"{city}今天晴,气温18-25℃" 创建Agent agent = create_agent( model="gpt-4o", tools=[get_weather], system_prompt="你是一个专业的天气助手,根据用户需求查询天气。" ) 执行查询 result = agent.invoke({ "messages": [{"role": "user", "content": "上海今天天气怎么样?"}] }) print(result)

第四步:运行验证

上海今天晴,气温18-25℃,适合户外活动。这个简单的示例展示了AI助手的核心工作流程:Agent读取用户自然语言输入 → 判断需要调用天气工具 → 提取参数(城市名) → 执行工具函数 → 返回结构化回答-21。

四、关联概念:RAG与记忆管理

4.1 什么是RAG?

RAG(Retrieval-Augmented Generation,检索增强生成) 是一种将信息检索与文本生成结合的技术框架,本质是“先检索资料,再让大模型基于资料生成答案”-28。

传统大模型的局限在于:

知识存在时效性,无法获取最新信息

无法访问企业私有数据

容易产生“幻觉”(Hallucination)

RAG通过三步流程解决这些问题:

从知识库中检索相关内容

将检索结果作为上下文输入模型

大模型基于真实资料生成回答-28

4.2 RAG与AI助手的关系

RAG与AI助手的区别常被混淆,面试中是高频扣分点:

| 技术形态 | 核心定位 | 核心能力边界 |

|---|---|---|

| 传统LLM | 智能体的“推理大脑” | 被动响应,无自主执行能力 |

| RAG系统 | 智能体的“记忆增强工具” | 仅完成检索-生成,无工具调度能力 |

| AI Agent | 完整的智能闭环系统 | 感知→记忆→规划→执行→反思全链路 |

简单来说:RAG是AI助手“记忆模块”的核心实现方式之一,而AI助手是包含RAG、工具调用、自主规划在内的完整智能系统-66。

4.3 带RAG的AI助手示例

构建带RAG知识库的助手 from langchain_community.vectorstores import Chroma from langchain_openai import OpenAIEmbeddings 1. 加载文档并创建向量库 documents = load_documents("knowledge_base/") vectorstore = Chroma.from_documents( documents, embedding=OpenAIEmbeddings() ) 2. 创建检索器 retriever = vectorstore.as_retriever(search_kwargs={"k": 3}) 3. 创建Agent(带检索工具) def search_knowledge(query: str) -> str: docs = retriever.invoke(query) return "\n".join([doc.page_content for doc in docs]) agent = create_agent( model="gpt-4o", tools=[search_knowledge, get_weather], system_prompt="你可以从知识库中检索信息来回答问题。" )

这种架构让AI助手既能访问私有知识库,又能调用外部工具,实现真正的“数字员工”能力。

五、底层原理:支撑AI助手的关键技术

AI助手能够自主决策和调用工具,底层依赖多项关键技术的协同:

5.1 Function Calling(函数调用)

大模型在生成回复时,可以同时输出一个结构化的函数调用请求,而不是纯文本。这要求模型经过专门训练,能够识别用户意图并映射到预定义的工具函数。

5.2 规划算法

ReAct(Reasoning + Acting) :模型边思考边行动,每走一步看结果再决定下一步,灵活度高,适合需要动态调整的场景-68。

CoT(Chain-of-Thought,思维链) :要求模型输出中间推理步骤,将复杂问题拆解为可验证的子任务-64。

5.3 向量检索与语义匹配

RAG系统将文本转换为向量表示(Embedding),通过相似度从知识库中快速召回最相关内容。Embedding模型的质量直接决定了检索的上限。

5.4 记忆管理

短期记忆:当前会话的消息记录 + 状态变量

长期记忆:跨会话的用户偏好、知识提取,通常存储在向量数据库中-68

这些底层技术共同构成了AI助手从“理解”到“行动”的完整能力链条。后续进阶内容将深入源码级别的实现细节。

六、高频面试题与参考答案

以下整理5道AI助手/智能体方向的高频面试题,结合2026年最新面试趋势-65:

Q1:Agent和LLM、RAG的区别是什么?

参考答案: LLM是Agent的核心推理单元,仅具备文本理解与生成能力;RAG是Agent记忆模块的实现方式之一,只能完成检索-生成任务;而AI Agent是包含LLM、RAG、工具调用、自主规划在内的完整智能闭环系统,具备“感知→规划→行动→记忆→反思”全链路能力。大模型是能力底座,AI助手是交互入口,智能体是把能力转化为生产力的执行形态。

Q2:Agent工具调用失败如何处理?

参考答案: 建立分级处理策略:网络错误采用指数退避重试,最多3次;限流错误等待窗口期后重试;输入无效请求用户修正;关键API准备备用方案形成降级链(主API→备用API→缓存→人工介入)。同时将错误信息结构化返回给模型,让模型自主决策后续策略-67。

Q3:Agent框架如何选型?LangChain的优劣势是什么?

参考答案: 选型考虑生态成熟度、社区活跃度、定制灵活性。LangChain优势是生态完善、组件化灵活,但劣势是抽象层级多、启动较慢、定制成本高。轻量场景可考虑LlamaIndex或自研核心流程。设计优化方向是分层架构,核心流程保留、组件可插拔-65。

Q4:如何解决Agent的上下文窗口溢出问题?

参考答案: 组合使用:①早期对话压缩为摘要;②长任务拆分子任务,独立对话后汇总;③关键信息存入数据库,需用时检索;④使用Sliding Window控制上下文长度;⑤必要时换用支持长窗口的模型兜底-68。

Q5:Agent最常见的失败场景是什么?

参考答案: ①工具调用失败(参数格式错误、API返回异常)→参数校验+重试+人工兜底;②上下文溢出→摘要压缩+滑动窗口;③目标漂移(偏离原始任务)→每步目标对齐+定期反思重新规划-65。

七、总结与进阶方向

本文核心知识点回顾

| 要点 | 说明 |

|---|---|

| 概念辨析 | AI助手≠AI智能体,大模型是“大脑”,AI助手是“会说话的大脑”,智能体是“数字员工” |

| 核心架构 | 感知→规划→行动→记忆的认知闭环 |

| 开发框架 | LangChain提供create_agent函数,遵循ReAct模式 |

| 记忆增强 | RAG技术连接外部知识库,降低幻觉风险 |

| 底层原理 | Function Calling + 规划算法 + 向量检索 + 记忆管理 |

进阶学习方向

多智能体协作:从单体Agent走向Multi-Agent协同,构建“数字工厂”-11

生产级部署:结合FastAPI服务化、Docker容器化、监控与A/B测试-21

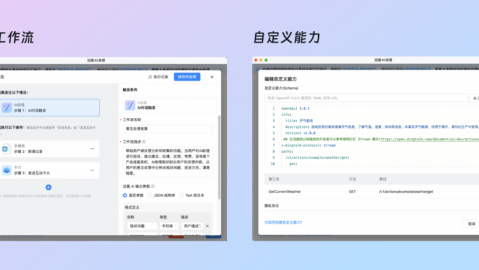

零代码方案:了解Dify、Coze等平台,快速验证业务场景-45

底层框架:深入学习LangGraph实现精细化编排,或探索轻量级自研方案

学习资源推荐

| 类型 | 资源 |

|---|---|

| 官方文档 | LangChain官方文档、Dify官方文档 |

| 平台实践 | Coze(扣子)零代码平台 |

| 学习社区 | Hugging Face、阿里云开发者社区 |

AI助手技术正以惊人的速度演进。从学会如何创建AI助手开始,你不仅掌握了当下最热门的技术能力,更获得了一把通往未来智能时代的关键钥匙。建议从最简单的天气助手开始动手实践,逐步增加工具、接入知识库,在实践中深化理解。

思考题:在你的日常工作中,哪个场景最需要AI助手来提升效率?欢迎留言交流。